意大利禁用ChatGPT,“反AI同盟”正在集结?

导读:在喧嚣舞台的周围,“反AI同盟”也在集结中。对于ChatGPT产品的质疑,对于通用人工智能技术的警惕,甚至是对本次科技革命的担忧和恐惧情绪,也甚嚣尘上。

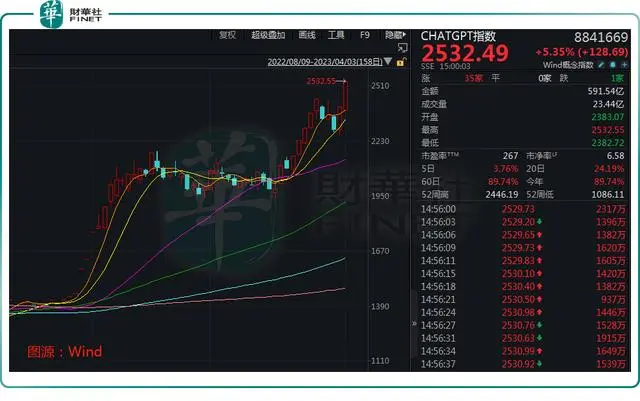

近期的市场,可谓AI霸屏,甚至有不少基金经理喊出ALL IN人工智能,自1月末行情启动以来,涨幅翻倍以上的个股不在少数,比如寒武纪(688256.SH)、中际旭创(300308.SZ)、三六零(601360.SH)、云从科技(688327.SH)、海天瑞声(688787.SH)、昆仑万维(300418.SZ)等等。

但是光环的另一边,在喧嚣舞台的周围,“反AI同盟”也在集结中。对于ChatGPT产品的质疑,对于通用人工智能技术的警惕,甚至是对本次科技革命的担忧和恐惧情绪,也甚嚣尘上。

近日,意大利数据保护机构对OpenAI公司非法收集用户信息展开调查。意大利个人数据保护局宣布,即日起禁止使用聊天机器人ChatGPT,并限制开发这一平台的美国人工智能公司OpenAI处理意大利用户信息。此举也让意大利成为首个禁用ChatGPT的国家。

对此,OpenAI表示,“在训练ChatGPT等人工智能系统时,我们积极致力于减少个人数据。因为我们希望我们的AI能了解世界,而非个人。”

欧盟执法机构欧洲刑警组织也警告称,ChatGPT可能被滥用于网络钓鱼、虚假信息和网络犯罪。众所周知,欧洲近些年一直对科技监管采取谨慎态度,这避免了很多问题,但也有业内人士认为,监管过多变相导致了一个结果,就是作为老牌资本主义国家的聚集地,在近二十年的互联网浪潮中,斩获不多。全球互联网巨头要么在美国,要么在中国,这和欧洲过往在科学技术浪潮中的应有的地位并不相称。

值得一提的是,不少科技巨头也对AI技术的狂飙较为警惕。据多家韩媒3月31日报道,三星电子内部发生3起ChatGPT滥用与误用事件。公司员工将半导体设备测量数据库、产品良率等内容输入ChatGPT中,还有员工要求ChatGPT制作会议记录,这些内容或已存入ChatGPT学习数据库,从而导致公司企业机密可能外流。微软和亚马逊此前已禁止员工向ChatGPT分享敏感数据,以防公司机密信息泄露。

大学、教育机构自然也是“反AI同盟”的重要成员之一。此前,美国北密歇根大学的学生,用ChatGPT写了一篇有关宗教的论文,结果拿了最高分。很快,类似事件在美国校园大面积泛滥。据在线教育机构Study.com调查,89%的美国大学生在用ChatGPT写作业,53%的学生用它写论文,甚至还有48%的学生会用来完成考试。

美国高校如临大敌。以纽约大学为代表的一派,将使用ChatGPT等AI工具定性为“作弊”,涉嫌学术诚信问题,进行封杀。另一些高校,则从技术上进行反制。例如斯坦福大学专门开发了DetectGPT,用来检测文章是否由AI生成。而纽约教育局选择“一刀切”,直接颁布禁令阻止所有部门设备、网络访问ChatGPT。

大佬们也没闲着,作为曾经的全球首富,马斯克更是著名的“反人工智能斗士”,他一直坚信不受控制的人工智能“可能比核武器更危险”,自爆对AI的发展感到焦虑。2023年3月下旬,马斯克等多名科技公司高管和顶级AI研究人员也已签署一封公开信,呼吁所有人工智能实验室立即暂停比GPT-4更强大的人工智能系统的训练,暂停时间至少为6个月,应制定相关安全标准,防止AI技术带来潜在危害。

事实上,马斯克正是OpenAI公司的联合创始人之一,他于2018年离开了OpenAI的董事会,在离开后,马斯克就一直在批评后者,甚至矛头直指OpenAI背后的微软和比尔·盖茨。去年11月ChatGPT发布时,OpenAI瞬间成为科技界的网红公司,马斯克对此十分生气。

然而,作为马斯克的宿敌,比尔·盖茨对GPT评价很高。他在GPT-4发布后曾发长文表示,GPT模型是40余年来最革命性技术进步。对于人工智能迅速走红掀起的担忧,比尔·盖茨认为,不安是社会对颠覆性新技术出现的本能反应。

整体来说,自ChatGPT横空出世以来,人工智能行业像开挂一样,迎来迅猛发展的大趋势。微软谷歌等硅谷大厂,还有国内科技巨头的战争,也已经进入了白热化阶段。但在兴奋的同时,“反AI同盟”的呼声越发高涨,很多人对其引发的风险感到担忧。此外,AI的狂飙,会不会影响打工人的饭碗,很多岗位是否会被彻底淘汰出局,AI浪潮席卷之下,是否会出现“失业潮”,都不好说。

笔者认为,自从工业革命以来,各种工具层出不穷,我们虽然在体能上远远输给了机器,但我们的脑力从来没有输给过机器。但如果AI进一步变得更强大的话,脑力也没有AI聪明了。到那时,人类的价值体现在哪里,社会将呈现何种形态,不得不说,都是值得思考的问题。